テキストから高品質な動画を生成するAI技術は、目覚ましいスピードで進化を続けています。そんな中、Genmo.aiが開発した「Mochi 1」は、新たな可能性を切り開く存在として注目を集めています。

このAIモデルは、オープンソースでありながら商用レベルの性能を持ち、動画生成AI技術をより多くの人々が利用できるようにすることに大きく貢献しています。

この記事では、Mochi 1が持つ特徴、具体的な使い方、そして利用に必要なコンピュータのスペックについて、詳しくご紹介します。

Mochi 1とは?

Mochi 1は、Genmo.aiによって2024年10月23日に公開された、動画生成AIです。

ユーザーが入力したテキスト(プロンプト)をもとに、高品質な動画を生成することができます。

このモデルは、100億ものパラメータを持つ非常に大規模なものであり、「非対称拡散変換器(AsymmDiT)」と呼ばれる独自の技術アーキテクチャを採用しています。

これにより、従来のオープンソースモデルを超える、非常に滑らかで高品質な動画を作り出すことが可能になりました。

さらに、Mochi 1はApache 2.0というライセンスの下で公開されているため、個人的な趣味のプロジェクトからビジネスでの利用まで、非常に幅広い用途で活用できる点が大きな魅力です。

Mochi 1の主な特徴

Mochi 1が多くの注目を集める理由は、その優れた機能にあります。ここでは主な特徴をいくつかご紹介します。

高品質な動画生成能力

Mochi 1の最大の魅力は、その卓越した動画生成能力にあります。

特に、水面が揺れる様子や風になびく髪、人や動物の複雑な動きといった、現実世界さながらの自然な動きを表現することを得意としています。

さらに、秒間30フレーム(30fps)で最大5.4秒という滑らかな映像を作り出せる点や、水や煙といった流体、さらには髪の毛の動きまでもシミュレートできる能力は、特筆すべき点でしょう。

優れたプロンプト理解力

高品質な動画を生み出す背景には、Mochi 1の優れたプロンプト理解力があります。

Googleが開発した強力な言語モデル「T5-XXL」を採用することで、ユーザーが入力したテキスト指示を効率的に処理し、その意図を正確に汲み取ります。

一度に4万個以上もの映像情報を処理できる能力を持ち、シーンの構成要素、登場人物の動作、時間帯や雰囲気といった細かな要望にも応えることができます。

オープンソースの利点

Mochi 1が注目されるもう一つの大きな理由は、オープンソースであるという点です。

モデルの設計情報(重み)やプログラム(ソースコード)が無料で公開されており、誰でも自由にアクセスできます。

これにより、世界中の開発者が改良に参加できるコミュニティ主導の開発が可能になっています。

また、Apache 2.0ライセンスの下で提供されているため、個人での利用はもちろん、商用目的での活用も可能です。

Mochi 1の技術的詳細

Mochi 1の高い性能を支える技術的な側面について見ていきましょう。

アーキテクチャ

Mochi 1の技術的な心臓部となっているのが、Genmo独自の「非対称拡散トランスフォーマー(AsymmDiT)」と呼ばれる新しいアーキテクチャです。

このアーキテクチャは、テキスト情報よりも動画データの処理に重点を置いており、割り当てられる計算資源(パラメータ)も動画処理の方が4倍多くなっています。

全体で100億ものパラメータを持つこのモデルは、これまでに公開されたオープンソースの動画生成モデルとしては最大規模を誇ります。また、「ビデオVAE」という技術を活用して動画データを効率的に圧縮し、メモリ使用量を抑える工夫もされています。

さらに、「マルチモーダル自己注意機構」により、テキストによる指示と動画の内容を同時に、かつ関連付けながら処理することができます。

出力仕様

現在、Mochi 1が生成する動画の基本的な仕様としては、解像度は480pに対応しています。

フレームレートは滑らかな動きを表現できる30fps、動画の長さは最大で5.4秒となっています。なお、より高画質な720pに対応する「Mochi 1 HD」も開発が進められています。

Mochi 1の使い方

Mochi 1を使って動画を生成するには、主に2つの方法があります。

1. オンラインプラットフォームを利用する方法

Mochi 1を試す最も簡単な方法は、Webブラウザ上で提供されている「プレイグラウンド」を利用することです。特別な準備は不要で、すぐに動画生成を体験できます。

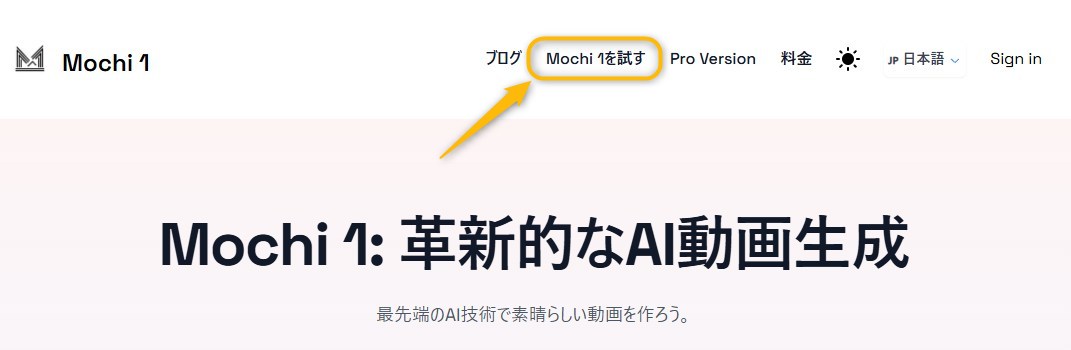

- Mochi 1にアクセスします。

公式URL:https://mochi1ai.com/ja - 画面右上の「Mochi 1を試す」より、画像生成ページへアクセスします。

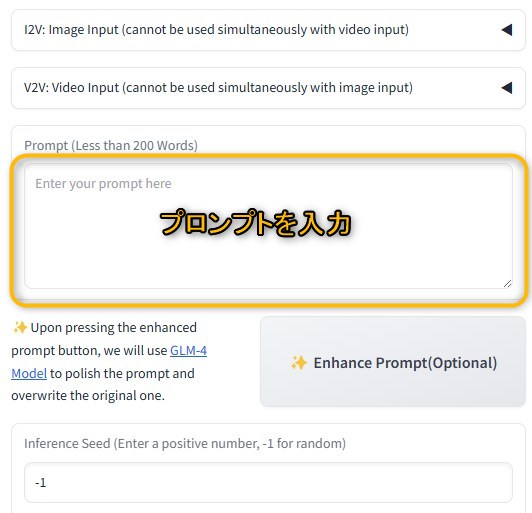

- プロンプト入力: 画面上の入力フォームに、作成したい動画の内容を説明するテキスト(プロンプト)を入力します。

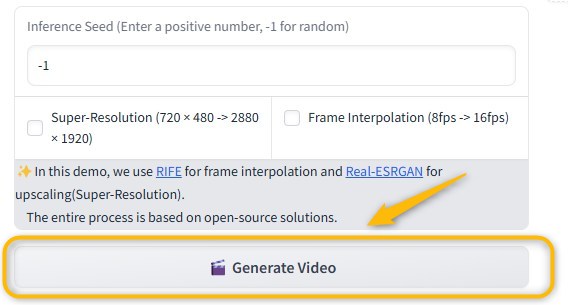

もし、どんなプロンプトを入力すれば良いか迷った場合は、「Enhance Prompt(Optional)」ボタンをクリックすると、ランダムなアイデアを提示してくれます。 - 動画生成: プロンプトが決まったら、「Generate Video」ボタンを押すだけで動画生成が始まります。

- ダウンロード: 生成が完了した動画は、ダウンロードアイコンをクリックして、ご自身のデバイスに保存できます。

「Mochi 1を試す」をクリック

プロンプトを入力

「Generate Video」をクリックして動画生成

プロンプト作成のコツ:

効果的な動画を生成するためには、プロンプト作成に少し工夫が必要です。

例えば、具体的で明確な指示を心がけ、どのような動きやアクションを含めたいかを詳細に記述します。

また、「アニメ風」「水彩画風」といった視覚的なスタイルを指定したり、シーンの時間的な変化や順序を考慮したりすることも、より意図に近い動画を作るためのポイントとなります。

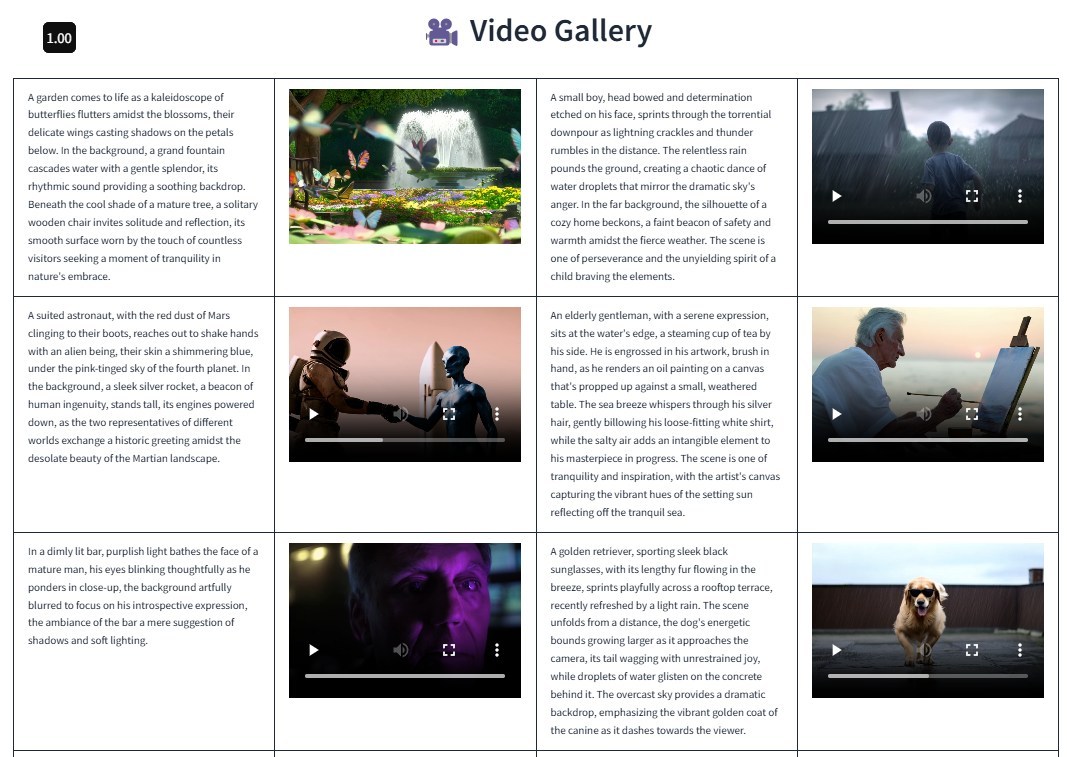

「Mochi 1を試す」ページの下部にVideo Galleryとして、サンプルのプロンプト動画例がまとめられていますので、こちらを参考にするのも良いでしょう。

2. ローカル環境で実行する方法(ComfyUI使用)

より高度なカスタマイズや、独自の動画生成プロセスを構築したい場合は、ご自身のコンピュータ(ローカル環境)でMochi 1を実行する方法があります。

特に「ComfyUI」というツールを使うのが一般的です。手順の概要は以下の通りです。

- モデルファイルのダウンロード: Mochi 1のモデルファイルを、モデル共有サイトのHugging Faceからダウンロードします。

- ComfyUIのセットアップ: ComfyUIをインストールし、Mochi 1が動作するように設定を行います。

- ワークフロー構築: ComfyUI上でMochi 1を使った動画生成の「ワークフロー」(処理の流れ)を組み立てます。

- 動画生成: 作成したワークフローにプロンプトを入力し、動画を生成します。

ローカル環境での実行は、オンラインプラットフォームよりも設定が複雑になりますが、より自由度の高い動画生成が可能になります。

必要なマシンスペック

Mochi 1は非常に大規模なAIモデルであるため、その能力を最大限に引き出すには、高性能なコンピュータが必要です。

開発元が公式に推奨しているスペックは、Nvidia社の高性能GPU「H100」を最低でも4台搭載した環境です。これは、一般的な個人の環境では用意するのが難しいレベルと言えるでしょう。

しかし、実際にユーザーが動作させた報告例を見ると、もう少し現実的な構成でも利用できる可能性はあります。

例えば、以下のようなスペックが目安とされています。

- OS: Ubuntu Server 22.04.5 LTS など

- GPU: NVIDIA RTX 3090 FE 以上

- RAM: 64GB 以上

- ストレージ: モデルファイル(約40GB)を格納できる十分な空き容量

ComfyUI向けには、ファイルサイズを削減したモデルも公開されており、これを利用すれば、NVIDIA RTX 4070Ti(VRAM 12GB)のようなミドルレンジのGPUでも動作させることが可能です。

ただし、その場合、生成速度などのパフォーマンスは制限される点に注意が必要です。

Mochi 1の活用事例

Mochi 1は、その高い性能を活かして、様々なクリエイティブな用途に応用できます。

- テキストから動画生成: 最も基本的な使い方です。「夕暮れ時の草原を駆ける馬」のような言葉で指示するだけで、その情景を描いた動画が自動的に生成されます。頭の中にあるイメージを簡単に映像化できる、非常に強力なツールとなります。

- 画像から動画生成: 静止画に動きを加えて、生き生きとした動画を作成することも可能です。風景写真に流れる雲や揺れる水面を加えたり、人物のポートレート写真に微妙な表情の変化を加えたりすることで、写真に新たな命を吹き込むことができます。

- 動画のスタイル変換: 既存の動画のスタイルを変換する機能も持っています。例えば、実写で撮影された映像をアニメーション風に加工したり、古いモノクロ映画を現代的なカラー映像にリマスターしたりといった応用が考えられます。

Mochi 1の制限事項

多くの可能性を秘めたMochi 1ですが、現時点ではいくつかの制限事項も存在します。

- 解像度制限: 生成される動画の解像度は、現状では480pまでとなっています。

- 動きの制限: 非常に激しい動きや複雑な動作を含む場合、映像に歪みが生じることがあります。

- スタイルの制限: 実写のようなリアルな表現に最適化されているため、アニメやカートゥーンといった特定のスタイルを生成するのは、現状ではあまり得意ではありません。

- ハードウェア要件: 最も大きな課題の一つが、動作に必要な高性能なハードウェアです。高性能なGPUが必須となるため、誰もが気軽に利用できるとは言えない状況です。

今後の展開

Mochi 1は、今後も継続的な開発が予定されており、さらなる進化が期待されています。

現在、より高画質な720pの解像度に対応する「Mochi 1 HD」バージョンの開発が進められています。また、静止画から動画を生成する機能の強化や、生成される動画の動きや内容をより細かくコントロールできる機能の追加も計画されています。

これらのアップデートにより、Mochi 1はさらに使いやすく、強力なツールへと進化していくことでしょう。

まとめ

Mochi 1は、オープンソースでありながら商用レベルの高品質な動画生成を実現する、画期的なAIモデルです。

100億という膨大なパラメータと独自の「非対称拡散トランスフォーマー」アーキテクチャにより、驚くほど滑らかでリアルな動画を生み出すことができます。

Webブラウザから手軽に試せるプレイグラウンドや、ローカル環境で高度な設定が可能なComfyUIなど、ユーザーのスキルレベルに合わせた使い方が提供されています。

ただし、その性能を引き出すためには高性能なコンピュータが必要であることや、解像度や表現できる動きにまだ制限がある点には注意が必要です。

今後の開発によって、解像度の向上や機能の追加が予定されており、動画生成AIの利用をより身近なものにする可能性を秘めています。

テキストを入力するだけで高品質な動画が生成できるMochi 1は、クリエイターや開発者にとって、創造性を飛躍的に高める強力な味方となるでしょう。